Den meisten Konferenzen, so auch der Tagung des Verbands Digital Humanities im deutschsprachigen Raum, ist ein Workshopprogramm dem Vortragsprogramm vorangestellt, das sich durch ein weites Format- und Themenspektrum auszeichnet. In diesem Jahr (2023) wurde sich bei der DHd sowohl in Form eines Hackathons und Netzwerktreffens über Data Feminism ausgetauscht, über die ökologischen Aspekte der Arbeit in den DH diskutiert als auch in verschiedenen methoden- bzw. toolfokussierten Workshops in die kürzlich veröffentlichen Python-Packages GitMA (Vauth et al. 2021a) und MONAPipe (Dönicke et al. 2022) eingeführt. Beide Packages wurden im Kontext der Computational Literary Studies (CLS) entwickelt, lassen sich aber auch darüber hinaus in Projekten der DH anwenden: Mit GitMA lassen sich Annotationsprojekte, die mit CATMA (Gius et al. 2022) durchgeführt wurden, mit Hilfe von Python analysieren. In der MONAPipe werden Systeme aus verschiedenen narratologischen Forschungsprojekten zusammengeführt und in einer anpassbaren spacy-Pipeline (Honnibal et al. 2021) über Python ausführbar gemacht.

Im Folgenden geht es um die Erfahrungen aus dem GitMA- und dem MONAPipe-Workshop, angefangen mit einer Beschreibung des Formats, weiter mit einem Überblick über den Inhalt und abschließend mit einem kurzen Fazit.

2. GitMA

Die Voraussetzungen für die Teilnahme an dem GitMA-Workshop bestanden einerseits in der allgemeinen, technischen Kenntnis der Programmiersprache Python, andererseits in der speziellen Kenntnis des Annotationstools CATMA und damit einhergehend auch in der Kenntnis der verschiedenen Aspekte der Methode des Annotierens. Diese beinhalten z.B.:

- Die Voraussetzungen: Es werden klar definierte Annotationskategorien und -einheiten benötigt.

- Die Praxis selbst: Die Kategorien werden Annotationsrichtlininen folgend an den Untersuchungsgegenstand (in diesem Fall Text) angelegt und durch Markierung gekennzeichnet. Es sollte dabei bestenfalls mehrere Annotator:innen geben, deren Annotationen verglichen werden können.

- Die Anwendungsszenarien: In den CLS zum Beispiel für die Bearbeitung von narratologischen Fragestellungen.

Der Aufbau des Workshops bestand in einem Wechselspiel aus theoretischem Input verschiedener Länge sowie dem Vorführen der Tools CATMA und GitMA und praktischen Einheiten, in denen wir, die Teilnehmenden, mit Hilfe von zur Verfügung gestellten Jupyter Notebooks GitMA ausprobieren und auch auf unseren eigenen Annotationsprojekten ausführen konnten. Die Notebooks wurden über einen Docker-Container bereitgestellt. So können wir auf Grund der lokalen Ausführung auch nach dem Workshop noch mit den Materialien weiterarbeiten.

Angefangen wurde der Workshop mit einem Schnelldurchlauf durch CATMA, in dem gezeigt wurde, was CATMA, als ein für traditionell geisteswissenschaftlich arbeitende Nutzer:innen ausgelegtes Tool, leisten kann und wo eine Weiterverarbeitung der Annotationen mit anderen Tools wie GitMA notwendig wird. So ist es mit CATMA möglich, zusätzlich zur Kernfunktionalität der manuellen Annotationen, einen Text halbautomatisch zu annotieren und einfache Visualisierungen zu erstellen. Für komplexere Visualisierungen und für den Vergleich von mehreren Annotationen desselben Text mit denselben Kategorien müssen die annotierten Daten außerhalb von CATMA weiterverarbeitet werden.

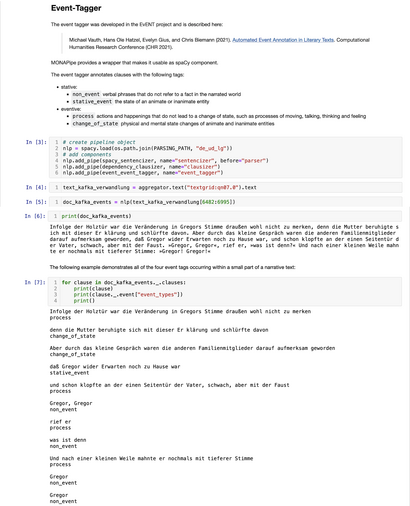

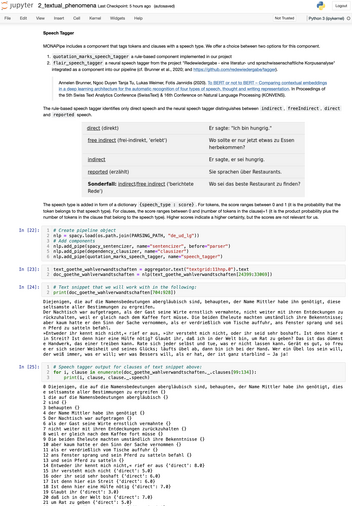

Dort setzt GitMA an, ein Python-Package mit dem die Annotationen, die im Hintergrund zeichengenau in einem GitLab Repository gespeichert sind, geladen und untersucht werden können. GitMA bietet Methoden zur – teilweise visuellen – Exploration der geladenen Projekte (siehe Abb. 1), zur Erstellung der finalen Gold-Annotationen und zum Vergleich von mehreren Annotationen mit Hilfe verschiedener Inter-Annotator-Agreement (IAA) Metriken (siehe Abb. 2).

ALLE BEITRÄGE

ALLE BEITRÄGE